计算机系统应该不伤害人类无论如何,这包括不要让人尴尬或让他们感觉不好。早在1942年,艾萨克·阿西莫夫(Isaac Asimov)就将“不伤害”原则确立为自己的原则机器人第一定律,但我们仍然没有达到不被电脑伤害的基本状态。尽管数字技术取得了惊人的成就,但许多系统从未让用户满意,许多公司仍然发布可用性灾难。

通过根据规范运行的系统是不够的。它不再足以让系统可用。一流的智能设备已经入侵了我们的世界,并在我们存在的几乎所有背景下都插入了自己。他们的缺陷和错误的互动不再是他们的 - 他们对他们的用户非常反映并在别人面前尴尬。

换句话说,通过使智能设备普遍存在,我们将自己暴露在外计算机辅助尴尬.我们必须扩展我们的可用性方法,不仅包括一个使用环境中的孤立用户,还包括在其他人在场时与系统进行交互的社会用户,以及一起使用系统的用户社区。

在早期的计算机时代,人们满足于简单地运行他们的计算机上的程序。可用性与功能和可理解性密切相关。随着数字系统成熟并变得更有能力,易于使用的担忧增长到用户体验设计领域,旨在提高人们在计算机使用之前,期间和之后的经验。关注任务完成和用户满意度扩展到关心人类公司互动的许多其他方面,如质量措施,人们对价值的看法以及他们对技术的情感反应。

计算机和智能设备已经成为社会角色。我们与他们交谈,他们回应,他们代表我们行事,在通信和商业中代表我们。数字助理潜伏在客厅里,听着每一个字,但他们经常误解人们的意思。随着系统变得更智能,我们期望它们会更有用,表现得更好。我们希望我们的软件是真实的,值得信赖的对我们彬彬有礼。

用户体验设计也必须关注社会的用户体验:在一群人的环境中使用技术的情景体验。我们需要了解我们设计的行为是如何适应或不适应家庭、工作环境、学校文化和游戏的。

晚餐、开放式办公室、体育活动和教堂服务都需要我们的数字系统和我们各自不同的行为。有些系统更符合我们的情境,例如通过设置会议模式或请勿打扰模式可以以可预测的方式覆盖正常设置。如果我们理解其后果,这些模式可能会非常有用,知道我们进入的模式,并记住何时切换。

有些系统走得更远:例如,它们通过使用传感器来检测动作,并利用来自时钟、地图和日历的信息来猜测意图或使用上下文来预测人们想要什么。有些系统甚至从人们的行为中学习。

然而,有些系统有导致尴尬的默认设置,例如公开报告你最私密的活动是锻炼或者在您期待深夜电话时自动关闭手机铃声。

社会尴尬

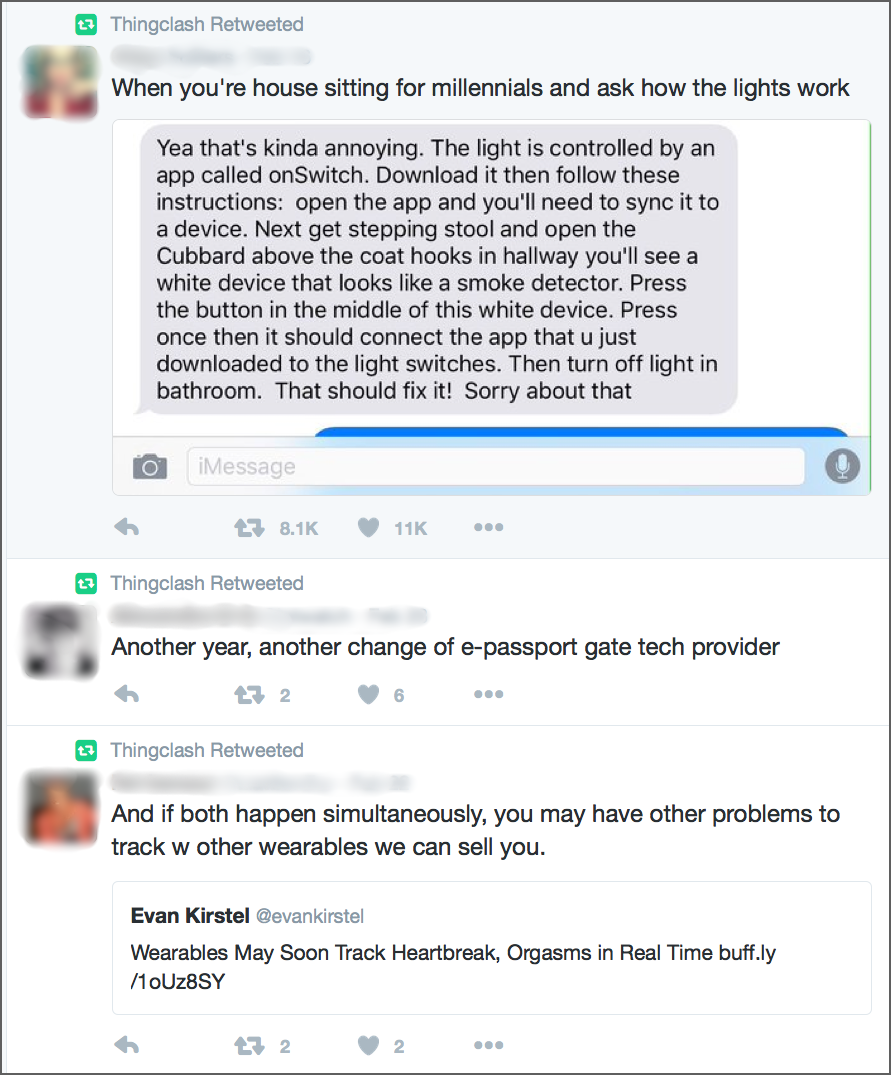

计算机辅助尴尬的例子数不胜数。下面是一些典型的问题。你可能会把自己的许多痛苦时刻加到这张清单上:

- 沟通灾害:消息传递系统通常可以很容易地包括意外的收件人或消息,或从意外的地址发送。当被认为是私人信息的信息被分发给整个小组时,小组短信往往以尴尬告终。

- 隐私泄密:系统经常曝光,分享,或者不是真正删除私人信息(如照片,名称和位置),有时在没有您逐步意识到问题。无线麦克风和您认为关闭或静音的摄像机实际上可以传输私人时刻。

- 可怕的时机:对于那些不使用24小时时钟的人,警报和约会可能默认为2 AM而不是2 PM。日历可能会邀请人们到1分钟的会议。不需要的声音效果可以破坏安静的时刻,例如剧本的音量,令人尴尬地陷入录音和会议。个人信息倾向于在正式演示期间弹出。

- 积极的帮助:自动更正或其他界面功能可能会让你在同事面前意想不到地尴尬。算法可以添加你的敌人你的联系人或快速拨号名单可能会引起痛苦甚至危险。

- 单尺寸适合 - 所有警报:Apps和Services经常使用自动邮件垃圾邮件联系人。通知可能会对所有设备发出噪音。从800英里之外的公众警报可以在半夜唤醒家庭中的每个人。即使某些技术或政策问题阻止您从曾经说的是,有时,侵入性升级通知有时不会“不谢谢”答案。

- 仅为一个性别,民族或能力设计的系统:图像搜索不承认黑人语音识别系统不适用于某些方言,以及不起作用的设备,除非您可以使用两只手只是一些方式的设计变得非常错误,因为团队设计系统就像自己一样。界面设计的第一定律是:你不是你的用户。这些系统对他们的创造者来说是一种尴尬,但更重要的是,它们也对被遗弃的人造成伤害和尴尬,这些人被遗忘了。

不够具体或不够准确的算法可能会造成很大的尴尬。例如,LinkedIn把一个犹太社会主义者的头像和一个白人至上主义者的政治活动的新闻结合起来在一个自动的电子邮件通知,并发送到错误的人的社交网络-仅仅因为两个人有相同的名字。根据Slate关于该事件的一篇文章,领英知道它有一个草率的软件,但还是使用了它,依靠读者在事后提交错误。《石板》杂志上那篇文章的作者威尔·约翰逊想知道,用类似的方法会有多少人被错误地宣布死亡。在职业社交网络中,极端的尴尬是致命的,即使它只会扼杀你的就业前景。

规划出意外的和潜在的有害用户后果(以及如何避免和减轻它们)应该是每个系统设计计划的一部分。首先问问自己,“可能会出什么问题?”

尴尬的电话时刻

移动电话引入了许多新的技术手段来让我们难堪。这里只是几个例子。

有些手机会在你的口袋或包里,或者当你只是想查看联系信息时,意外地打电话,而且有时你打完电话后,它们不会挂掉。

当你在讲电话时,附近的人可能会认为你在和他们说话。如果发生了这种情况,你将不得不向你想要交谈的人和你没有交谈的人道歉,你可能会给所有相关的人带来尴尬。

有时手机登机牌在你可以在机场使用之前就消失了。你应该在你的电子邮件附件、应用程序、浏览器下载区域中寻找它们,还是在你的相机应用程序中寻找它们?记录登机牌的位置是一项重要的工作额外的记忆负担和增加人民认知负荷.有时在登机口,你不得不再次通过在线登机程序,只是为了显示条形码,以便登机。没有压力。你这么做的时候,我们都会耐心等待。

航空公司客服代表在推特上收到了愤怒的乘客的投诉,他们的登机牌会消失。

幸运的是,航空公司和旅行者正在学习通过提供更好的说明、使用图像和返回打印来弥补这些问题。

电话银行或移动投票,任何人?电话护照和电话驱动程序许可证怎么样?失败的后果一直越来越严重。

良好的上下文可用性的例子

一些系统已经展示了Contextual-UX智能,可以帮助防止尴尬:

- Gmail警告你,如果你在邮件中提到了一个电子邮件附件,但没有附上一个。

- 一些安卓手机可以告诉你,你是否将到达一个关闭的企业。

- 一些汽车使得难以锁定或不小心留下车门解锁。

- 一些消息传递系统可以让你在同意做某件事的时候就在日历上添加约会。

社会缺陷也花钱

人们越来越多地用他们见过的最好的设计来衡量易用性:平庸的体验似乎是一半是空的,而不是一半是满的。当产品缺陷导致问题时,客户可能从口头宣传的倡导者变成长期负面评论的作者。

每当计算机系统表现不好时,它们就会影响到设计它们的人。通过与我们不够智能的系统交互,许多意想不到的事情可能会发生,这些事情可能会让我们非常尴尬,或者让我们感到糟糕。这些情感上的遗憾可能会持续很长时间,因为人们倾向于把不好的经历串联在一起。每一次羞辱都让我们想起以前的感受。这足以让你更喜欢纸和笔。

公司应该更加注意投资回报用于修复用户发现的问题。它更容易衡量时间浪费内联网的可用性改进但糟糕的设计也会浪费客户的时间、金钱,通常还会损害他们的尊严。

不要低估羞辱顾客的代价。没有人比忠诚的顾客对他们曾经喜爱的公司和产品失望更愤怒了。不管你能不能衡量,这种被背叛的感觉是昂贵的。

问题是如何发生的

安德鲁·辛顿在他的书中,了解上下文,解释说上下文崩溃导致了很多这样的问题:在一种环境下很好的活动在另一种环境下可能完全不合适,导致社交尴尬甚至更糟。数字和物理环境的排列在社会规范和我们对他人、组织、我们的数字系统和我们自己的期望上产生了冲突。

其中一些社会问题的出现可能是因为设计师和研究人员没有在正确的环境下测试系统,或者他们与错误的人进行了测试。但是社会缺陷也很难发现UX方法团队通常使用的。许多问题的发生可能是因为在实验室中测试了接口,一次一个用户, 与对实际环境、范围或使用规模没有理解或没有现实的模拟.系统可以在孤立中可以非常可用,在原型中,在安装之前,少量数据,当坐在桌面时,或仅在正确的照明中通过特定类型的用户;但是,当它在家里使用时,通过一群人,在公共场合或在进行正常的生活活动时,这些社会令人尴尬的问题出现。

在发布后修复问题可能很困难

如果你指望在系统发布后找到并修复令人尴尬的UX问题,请三思。通常是用户很难报告问题.一些公司也发现很难追踪和快速回应用户在网上发出的绝望的投诉。

许多系统释放后无法更改.这种不祥的情况通常在我们依靠和使用的技术中发现,例如手机,汽车,电脑设备(互联网路由器,车库,娱乐系统等家电),越来越多地在互联网上(IOT)生态系统。

重新启动你的汽车正变得越来越普遍,但升级它的软件可能是一个复杂的过程。看着你的智能家居变得不合格、不实用、不值得信任,这是一种没有人想要的未来生活。设计易于使用在上下文和随着时间的推移绝对是必要的.

如何在UX设计中查找和修复上下文问题

- 从设计良好的系统中学习让人感到聪明。

- 做领域的研究观察与该系统互动的人群,并随着时间的推移重复研究。当面试和测量用户,询问他们的情绪反应,包括烦恼和潜在的尴尬事件.

- 让人们在每天使用系统的同时自我报告他们的互动和任何事故或惊喜,例如,例如,通过使用日记研究和别的纵向研究方法.

- 在非常不同的上下文中考虑系统可用性,例如在国家(和公司)中,政治环境完全不同于你的。

- 无论预期用途如何,想想广泛的其他使用和滥用的可能性.

- 考虑如何恶意用户或不可信的系统操作员可能会利用这个系统来伤害他人。

- 考虑到科技生态系统和其他产品应该很好地配合你的产品。随着时间的推移,什么最有可能打破或改变?

- 尽早、频繁地进行测试与一个各种各样的人-单独和团体.

- 让更新易于做.确保您的系统可以随着时间的推移容易地修复,以减轻不可预见的问题并使人们保持更安全。

- 计划如何长期保持个人信息的安全.有些东西不属于云端。通常数据无法真正的匿名化、保护或删除,所以要非常小心哪些信息是默认共享的或自动从用户那里收集的。不要收集你保护不了的东西。

- 让用户控制他们的个人信息通过让他们意识到他们的选择和风险来分享选择。

- 考虑一下是否会产生环境和社会缺陷隐私、安全、法律和安全问题.

- 让任何人都可以轻松地报告可用性缺陷.从用户报告的问题中寻找期望不匹配和意外影响的线索。

- 讲述可用性问题的故事这奠定了它所属的责任,在系统及其政策上。

- 不要默默忍受.抱怨系统,让你和其他人不舒服或尴尬,无论你是否都在那个设计团队。公司倾向于修复许多人不满意的系统。

制度的社会缺陷很重要

一些专家预计,机器人将取代一半的人类工作,自动驾驶汽车将很快接管高速公路。无论如何,未来的系统将更加社会化,更加强大,更有能力造成伤害。随着人类对智能系统的依赖增加,软件质量和访问缺陷也很有可能成为业务责任问题,不管包上未读的免责声明说什么。

鉴于几十年前的软件的意外寿命,很容易预测,今天开发的一些系统可能会发生很长时间。如果我们希望人们能够愉快地与我们设计的系统相处,我们需要防止可用性问题,包括社会缺陷,并计划在部署后很长时间内修复和更新系统。

参考

Asimov,Isaac。机器人科幻系列,38个短篇小说和5个小说。全球各种出版商,1939-1986。

辛顿,安德鲁。了解上下文.ISBN 1449323170。O'Reilly Media,美国,2014年12月。

分享这篇文章: